近年、ソフトウェア開発におけるAI活用は、エンジニアリング領域で欠かせない存在になりました。

DORA(グーグル)のレポートによると、90% のテック専門家が日常業務でAIを活用しています。また、GitHub は 世界のソースコードの41% がAI生成コードであり、Javaプロジェクトでは 61% に達すると報告しています。

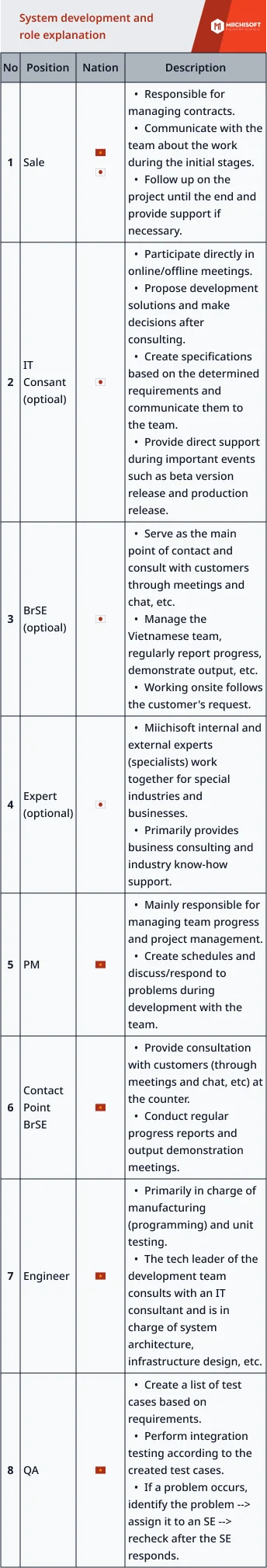

ソフトウェア開発におけるタスク別AI活用の比較:2025年 vs 2024年

しかし、生産性向上の裏側では、懸念すべきリスクも増加しています。IBM の調査では、13% の組織がAI関連の情報漏えいを経験したと回答しました。これにより、多くの企業がAI導入時に「データセキュリティ」を最大の課題として認識しています。

本記事では、MiichisoftのCDOが安全なソフトウェア開発におけるAI活用について、実務視点で解説します。

AIをソフトウェア開発に取り入れる際の4つの主要リスク

① 公開AIツール利用によるソースコード・内部情報の漏えい

最も一般的かつ深刻なリスクは、エンジニアが誤って顧客情報や内部資料を公開AIに入力してしまうことです。

送信された情報は外部サーバーに保存され、ログに残ったり、モデル学習に利用される可能性があります。

最も代表的な例が、2023年のSamsung(サムスン)の事例です。

サムソンのエンジニアがChatGPTに内部コードを貼り付けてしまったことで機密情報が漏えいし、サムソン は生成AIの利用を全面禁止しました。このケースは、ソフトウェア開発におけるAI活用において、企業が初期段階で適切な規制を敷くことの重要性を示しています。

出所:Google

② AI生成コードに潜むセキュリティ脆弱性

これは、ソフトウェア開発におけるAI活用で最も一般的なリスクの一つです。調査によると、AIが生成したコードの約45%にセキュリティ上の脆弱性が含まれていることが分かっています。AI生成コードには、入力値検証の不足、安全でないデータ処理、セキュリティ標準への不十分な準拠など、典型的かつ重大な脆弱性が混在するケースが多く見られます。

この問題の背景には、LLMが膨大なオープンソースコードを学習しているという仕組みがあります。そこには安全なコードと安全でないコードが混在しており、AIは不適切なパターンであっても「有効な解法」として学習・再現してしまう可能性があります。

そのため、企業はAIが生成したコードをそのまま本番環境に取り込むのではなく、必ずクロスチェックと丁寧なコードレビューを行うことが不可欠です。

③ データ汚染(Poisoning Attack)による攻撃リスク

AIモデルは「データポイズニング攻撃」の標的になる可能性があります。これは、攻撃者が学習データに悪意ある情報を混入させたり、プロンプトを悪用してモデルの弱点を突く手法です。

その結果、AIはユーザーが気づかないまま、脆弱性を含むコードや危険な振る舞いを生成してしまうことがあります。

2023年の研究では、AIコーディングアシスタントはこの種の攻撃に非常に脆弱であることが示されています。特に、企業がソフトウェア開発におけるAI活用を進める際に、出力の評価プロセスやデータソースの厳格な管理を行わない場合、リスクは大幅に高まります。

④ 外部クラウドに送信されたデータの管理不能

クラウド型AIツールを利用する場合、送信したデータが完全に削除されるのか、あるいはサービス提供側によって別の目的で利用されないのかを、企業側が確実に保証することはほとんどできません。

この点も、サムソンが懸念を抱き、ChatGPTの社内利用を即時禁止した理由の一つです。実際、内部データを一度でも第三者のシステムに送信してしまうと、完全に「回収」することは極めて困難です。特に、自社のコアソースコード、営業秘密、ユーザーデータを扱う企業にとって、このリスクは非常に深刻と言えます。

Miichisoft CDOの視点:実務における安全なAI活用プロセス

このような状況を踏まえ、MiichisoftのCDOであるグエン・ハ・タン氏は、実務上の観察と、ソフトウェア開発におけるAI活用時のデータ保護方法について共有しています。氏によると、最も大きなリスクは、特に顧客情報などの機密データが外部に漏れる可能性です。

このリスクを最小化するため、Miichisoftでは三つの重要な施策を実施しています。

・知識の向上。

・作業プロセスの標準化。

・従業員の教育。

人材面では、教育が鍵となります。社員は経験やプロセスを効果的に活用する方法を学ぶとともに、安全にAIを使用するスキルを習得し、顧客のセキュリティポリシーに準拠するよう徹底されています。

最後に、AIの力を最大限に活用するために、常にプロセスと作業方法を改善し、開発スピードの向上と顧客データの厳格な保護を両立させていると、強調します。

ここで、タン氏が語る、ソフトウェア開発におけるAI活用時のデータ保護の実践に注目してください。

Miichisoftにおけるソフトウェア開発におけるAI活用のセキュリティプロセス

ソフトウェア開発にAIを安全かつ管理された形で導入するために、Miichisoftでは明確な5ステップのセキュリティプロセスを構築しています。

このプロセスにより、顧客データは常に保護され、開発環境はセキュリティ要件を満たし、AIに関連するすべての操作が安全な範囲内で行われることが保証されます。

ステップ1:顧客とのセキュリティ方針の合意

AIを活用するすべてのプロジェクトは、まず顧客からの許可範囲、規定、使用制限を明確に定めることから始まります。エンジニアは、顧客からの明確な承認がある場合にのみAIを使用でき、データは合意された範囲内でのみ処理されます。

これにより、内部情報、ソースコード、機密データが誤って外部に流出することを防ぎます。このような遵守体制が、ソフトウェア開発におけるAI活用を最初の段階から安全に進める基盤となります。

ステップ2:適切かつ安全な生成AIツールの選定

すべてのAIツールが使用可能なわけではありません。Miichisoftでは、社内AIやセキュリティ基準を満たした生成AIソリューションを優先的に使用し、顧客の承認を得たもののみを採用しています。公開AIサービスにデータを送信することは一切避けています。

適切なツールを選ぶことで、チームはAIの性能を最大限に活用しつつ、データが管理されていない公開サービスや第三者に送られるリスクを回避できます。

ステップ3:安全な開発環境の構築

データ漏えいを防ぐため、AI開発環境はプロジェクトのデータ処理システムと完全に分離されています。アクセス権は厳格に管理され、役割ごとに明確に区分されており、権限を持つエンジニアのみが利用可能です。また、すべての操作は監視されています。

この設定により、顧客データがAI実験環境と混在することを防ぎ、個人端末や公共ネットワークからの漏えいリスクも最小限に抑えられます。

ステップ4:開発プロセスへのAI活用

AIは、適切な工程の効率化や自動化を支援するために使用されます。

具体的には以下のようなタスクです。

・コードの提案、レビュー、最適化。

・仕様書や技術レポートなどのドキュメント自動化。

・バグ分析やデバッグの支援。

さらに重要なのは、AIはユーザーデータベースや重要仕様など、機密性の高いデータの処理には使用されないという点です。これにより、重要な意思決定は常に人間が管理し、AIの出力に潜む潜在的なエラーや脆弱性によるリスクを最小化できます。

ステップ5:導入前の安全確認と検証

AIをプロジェクトで正式に使用する前に、PMおよびCTOがプロセス全体を確認し、安全性を評価します。さらに、Miichisoftでは定期的なセキュリティチェックを実施し、AIの利用がプロジェクト期間中の顧客データに影響を与えないことを確認しています。

この最終チェックは、AIに関連するすべての活動において、透明性と安全性を維持するための最後の防護策となります。

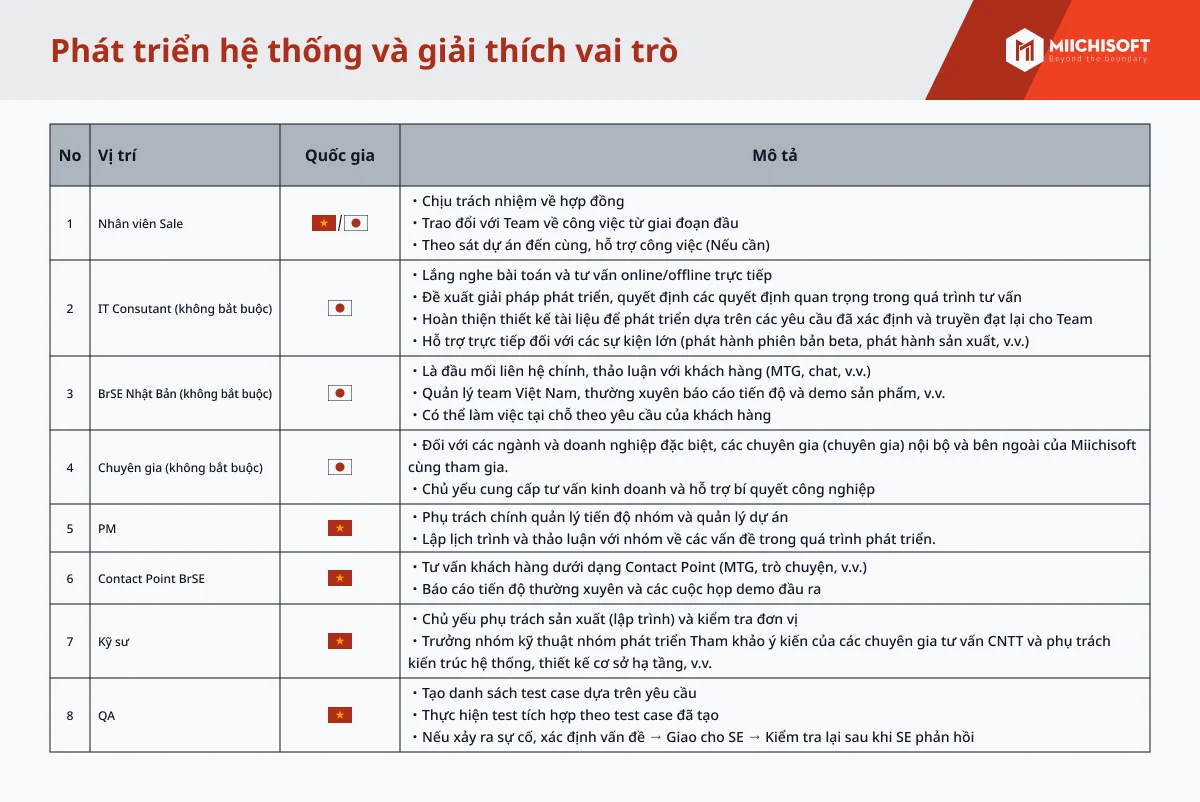

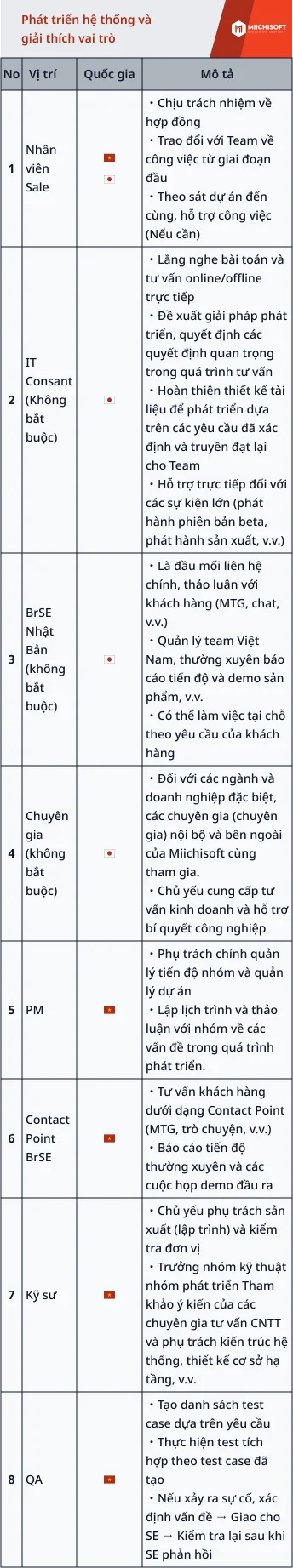

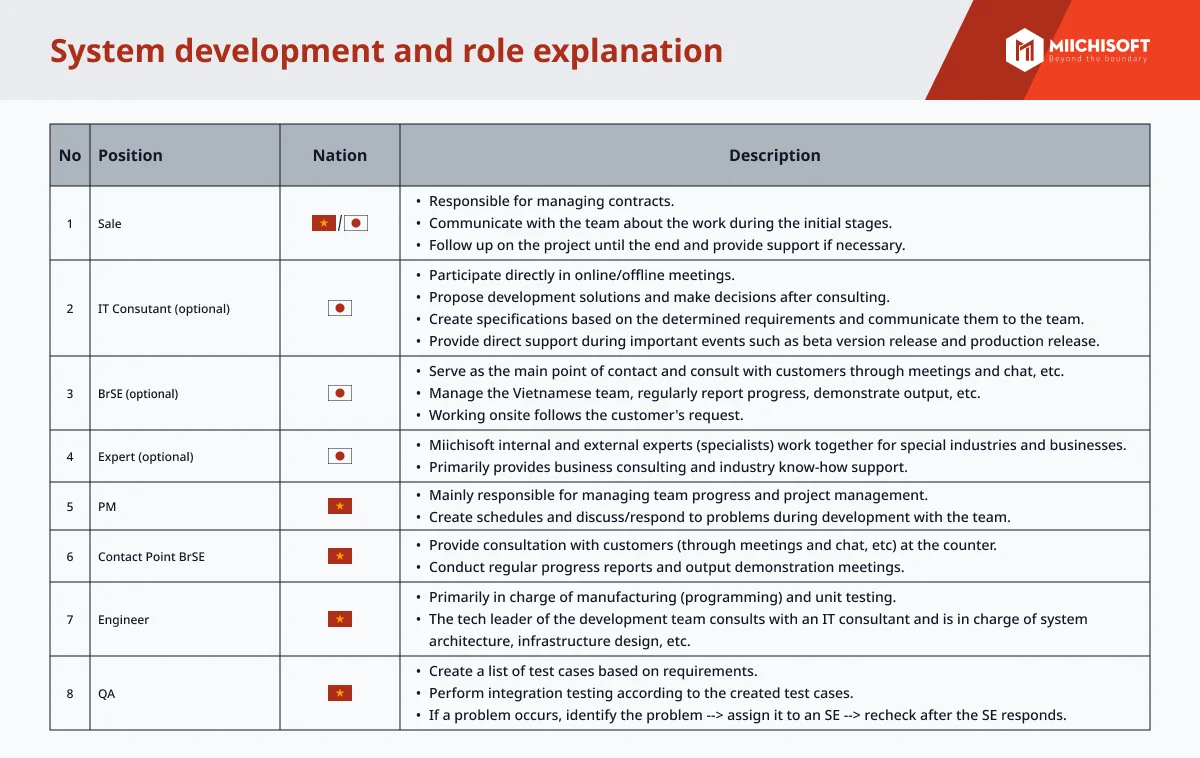

Miichisoft:企業向け安全なAI活用ソリューション

AIがソフトウェア開発においてますます重要なツールとなる中、多くの企業は依然としてセキュリティリスクを懸念しています。AIを効果的に活用するには、技術に精通し、かつセキュリティプロセスを熟知した経験豊富なパートナーが不可欠です。

Miichisoftは、AIと日本語に強みを持つチームを擁し、日本企業との直接のプロジェクト経験や、日本国内オフィスでの対応実績があります。私たちは厳格なセキュリティ管理プロセスを適用し、安全な環境でAIを導入することで、ソフトウェア開発におけるAI活用のスピードを向上させつつ、人為的ミスを減らし、顧客データを常に厳重に保護します。

企業がAI導入で課題を抱えている場合は、Miichisoftまでお気軽にご相談ください。無料でのアドバイスも承っております。

FAQ

Q1:Miichisoftの開発者はChatGPTなどの公開AIツールを使用できますか?

A1:いいえ。重要なプロジェクトデータや顧客情報は、いかなる公開AIツールにも送信しません。これにより、顧客情報の安全性を確保しています。

Q2:データはAIモデルによってログとして記録されますか?

A2:いいえ。Miichisoftでは、ローカル環境やプライベートクラウド上でAIモデルを運用しており、すべてのデータは当社と顧客の管理下にあります。外部にログとして保存されることはありません。

Q3:顧客がAIの使用を許可しない場合、どう対応しますか?

A3:顧客の要望を完全に遵守し、許可されていないAIツールは一切使用しません。開発プロセス全体が、顧客のポリシーに沿った安全な運用となります。

Q4:AIを顧客の社内環境に直接導入できますか?

A4:はい。すべての生成AIモデルはカスタマイズ可能で、顧客のオンプレミス環境に安全に展開できます。これにより、データが外部に流出するリスクを回避できます。

Q5:AI活用によって、効率やセキュリティはどのように向上しますか?

A5:Miichisoftでは、AI活用における経験豊富なチームと厳格なセキュリティ管理、さらに日本企業向けの豊富なプロジェクト経験を活かしています。 これにより、ソフトウェア開発におけるAI活用のスピードを上げつつ、人為的ミスを減らし、顧客データを安全に守ることができます。